ODS 1

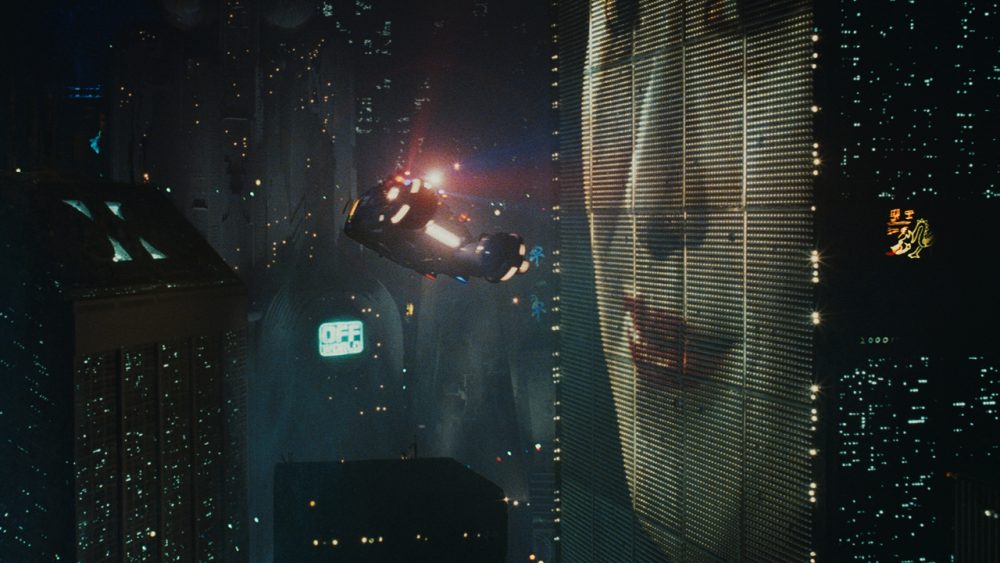

‘Blade Runner’: a ficção virou realidade?

Quais tecnologias do clássico 'O caçador de androides' e de sua sequência pularam da tela do cinema para o nosso cotidiano

“Nós não somos computadores, somos seres vivos”. Assim o replicante Roy Batty, vivido por Rutger Hauer no “Blade Runner” original de 1982, define sua espécie para o projetista/programador J. F. Sebastian (William Sanderson). Ali, na sombria Los Angeles de 2019, Roy põe na mesa o grande dilema do futuro dos sistemas digitais, robotizados ou abstraídos em software — serão eles algum dia tão perfeitos que não poderemos diferenciá-los do comportamento humano?

Mais: André Machado escreve sobre Ricardo III e Games of Thrones

Trinta anos depois, na Califórnia de 2049 mostrada no novo “Blade Runner”, os dilemas existenciais das máquinas continuam: o policial replicante K (Ryan Gosling), de uma nova geração obediente, incerto sobre o que se passa consigo, pergunta-se como saber se uma lembrança é uma memória real ou um implante num córtex de silício.

Produzidos em séculos diferentes e separados por 35 anos, tanto o clássico cult da ficção científica quanto a sua sequência, que acaba de entrar em cartaz, provocam o mesmo questionamento no espectador: afinal, algo mostrado por esses filmes já é realidade ou está perto de se tornar?

Robôs quase humanos?

Em se tratando dos androides inteligentíssimos e independentes da série Nexus (série 6 no filme original, 8 no atual), a robótica ainda não chegou lá. Existem vários ramos de pesquisa, como a “ciborguização” de membros do corpo para próteses, a robótica inspirada em processos biológicos e mesmo a confecção de “actroides”, isto é, androides com capacidade de emular ações humanas (fala, respiração, gestos etc), que vêm sendo objeto de estudos principalmente no Japão. Na Universidade de Osaka, o professor Hiroshi Ishiguro construiu uma robô-recepcionista em seu laboratório que aparenta ser bem avançada nas reações.

Para construirmos máquinas tão perfeitas quanto as vistas em ambos os filmes, seria preciso desenvolver uma inteligência artificial tão impecável que seria capaz de aprender sozinha, sem supervisão a partir de certo ponto e soubesse discernir entre o que é inteligência, erudição, intuição e astúcia, aplicando o modo conveniente a diversas situações, além de saber lidar com emoções (e reconhecê-las). Outras providências incluiriam sistemas musculares mais fluidos e flexíveis, que pudessem imitar a contento nossos movimentos.

Supondo que poderíamos construir tais máquinas, ainda que fossem realmente autônomas e independentes, elas teriam que seguir as três leis da robótica preconizadas pelo escritor e bioquímico Isaac Asimov, a saber:

1- Um robô não deve ferir um ser humano, ou, por inação, permitir que um humano seja ferido.

2- Um robô deve obedecer às ordens dadas por um humano, exceto quando elas estão em conflito com a Primeira Lei.

3- Um robô deve proteger sua própria existência desde que tal proteção não conflite com a Primeira Lei e a Segunda Lei.

Vê-se, portanto, que os replicantes do mundo de “Blade Runner” estão muito além do desejável. Na verdade (ALERTA DE SPOILER), quem assiste ao filme atual logo percebe que eles estão diante de um fato novo que os aproxima sobremaneira da humanidade.

De qualquer modo, a habilidade de cognição dos sistemas digitais no mundo real avança a olhos vistos. Recentemente, noticiou-se que o Facebook teria desligado um sistema de inteligência artificial que teria criado uma linguagem própria. Na verdade, o que os cientistas do caso fizeram foi modificar os parâmetros dos agentes de inteligência artificial para que usassem um inglês compreensível nas conversas.

“Agentes de inteligência artificial buscando executar uma tarefa são capazes de achar caminhos não-intuitivos para aumentar suas recompensas”, explicou num post no Facebook o professor Dhruv Batra, um dos envolvidos no experimento. “A ideia de um agente inventando sua própria linguagem pode soar alarmante ou inesperada para quem não conhece o setor, mas trata-se de um subcampo da IA conhecido há décadas. Mudar os parâmetros não é desligá-los”.

Além disso, um estudo das universidades de Toyohasi e Kyoto em 2016 demonstrou que os seres humanos podem ter empatia com robôs numa situação em que as máquinas estariam em situações de dor. O resultado foi medido por meio de um eletroencefalograma em 15 adultos observando imagens de mãos humanas e robóticas em situações de dor ou não.

“A diferença na empatia com humanos e robôs desapareceu ”, constatou o professor Michiteru Kitazaki no resumo do estudo.

Enquanto isso, as máquinas vão aprendendo. No mês passado, pesquisadores da Brigham Young University, nos EUA, inseriram o acervo da Wikipédia em sistemas de aprendizagem de inteligência artificial a fim de que os futuros androides equipados com tais informações compreendam e interajam melhor com o mundo a sua volta.

As grandes empresas, como Microsoft, Google, IBM, Amazon, Nvidia etc, estão todas obcecadas com isso

Segundo o professor Esteban Clua, do Instituto de Computação da Universidade Federal Fluminense (UFF) e diretor do Media Lab, a inteligência artificial recebeu grande impulso nos últimos três anos.

“As grandes empresas, como Microsoft, Google, IBM, Amazon, Nvidia etc, estão todas obcecadas com isso, e esse salto se deve principalmente a três razões: o big data (a imensa quantidade de dados disponíveis hoje), o grande poder de processamento em ambientes paralelos, como nas unidades de processamento gráfico (GPUs), e o avanço dos algoritmos que possibilitaram maior agilidade no aprendizado das máquinas”, diz Esteban. “Mas a inteligência artificial em sua essência é fazer com que a máquina aprenda padrões. Por exemplo, fornecer à máquina uma série de imagens de uma pessoa de modo que ela reconheça o indivíduo em qualquer situação daí por diante”.

Esteban vaticina que, dentro de algum tempo, é possível que vejamos máquinas capazes de aprender padrões apenas com a alimentação de dados, de informações no robô ou sistema, e não de uma programação prévia. Ressalva que isso ainda é um pouco radical, mas factível.

“Estamos entrando numa nova era da IA, sem dúvida, mas ela passará sempre pelo reconhecimento de padrões. O chamado aprendizado profundo (deep learning) busca exatamente isso: alimentar redes neurais com informações para que elas as processem e reconheçam padrões, aprendendo a lidar com eles”, diz o professor..

Daí a haver máquinas realmente capazes de emoções, como se vê nos filmes, trata-se de um grande salto no escuro e, segundo o professor, objeto de discórdia nos diferentes ramos que estudam a evolução da IA.

Comandos vocais e carros voadores

Os dois filmes trazem em seu bojo as sementes de algumas tecnologias que usamos bem hoje. Embora não haja telefones celulares no fictício 2019 do filme dos anos 80 — o policial Gaff, vivido por Edward James Olmos, chama pessoalmente Deckard (Harrison Ford) duas vezes para falar com o chefe –, existe muita interação com as máquinas por comandos de voz, utilizados cotidianamente nos dias atuais com a assistente Siri, da Apple, e o popular “Ok, Google” dos smartphones Android. Na Los Angeles de 2049 do segundo filme, essa característica é onipresente, inclusive nos carros voadores e na operação de drones estilizados que acompanham as investigações do policial K. Drones já são nossos velhos conhecidos.

Os carros voadores mostrados em ambos os longas-metragens ainda não estão por aí, mas podem aparecer justamente em 2019. A prova de conceito mais conhecida dessa tecnologia híbrida é o Transition, veículo da empresa americana Terrafugia, que vem sendo alvo de testes há anos. Para dirigi-lo, não bastará ter carteira de motorista, é preciso contar também com um brevê de piloto. Por outro lado, certamente veremos chegar ao mercado primeiro os carros sem motorista. Empresas como Tesla, Google, Mercedes e até o Uber estão investindo nessa tendência. O grande desafio aí é conseguir que todos os veículos, autônomos ou não, se comuniquem eficientemente com seus pares e todos os elementos no trânsito para evitar acidentes.

“Para o funcionamento dos próprios carros autônomos é essencial reconhecer padrões, como vimos mais acima”, comenta Esteban.

Luzes ambientes que se acendem ou apagam automaticamente, conforme as pessoas adentram ou saem de cômodos, também são mostradas já no filme de 1982. E, mesmo que não existam celulares nele, há pelo menos um “hangout” ou chamada de vídeo entre Deckard e Rachel (Sean Young) num videofone público num bar. Tecnologias que vingaram hoje, nestes tempos de casas e escritórios com sensores cada vez mais inteligentes (veja-se o Echo, da Amazon, ou o Assistant, do Google), e ligações de vídeo através do Skype ou do WhatsApp.

Hologramas rock’n’roll

Outdoors digitais interativos são preditos na Los Angeles de 2019; já na de 2049 eles evoluíram para hologramas gigantes. Os recursos de holografia já se tornaram uma realidade hoje, quando, por exemplo, um holograma de Elvis Presley (que aparece no filme) é mostrado caminhando para um show em que sua banda dos anos 70 o acompanha sincronizando com um vídeo. E a falecida lenda do heavy metal Ronnie James Dio ganhou uma versão virtual que vai começar sua própria turnê com banda em novembro próximo. Outros hologramas mostrados em “Blade Runner 2049” são de Marilyn Monroe e Frank Sinatra, este cantando dentro de uma jukebox.

Para Esteban, o holograma é “o Santo Graal da computação gráfica” perseguido pelas empresas tech da área, mas tem um problema intrínseco. “Você não pode parar a luz, portanto o holograma sempre precisa de uma superfície, de um ambiente contido onde possa ser projetado”.

Biometria da íris prevista

Do ponto de vista de tecnologias ópticas, o reconhecimento biométrico da íris existente hoje é profetizado no primeiro “Blade Runner”, nos testes aplicados nos replicantes com a chamada máquina Voight-Kampff, uma espécie de polígrafo futurista.

Outro recurso muito interessante, visto em ambos os filmes, é um software (Esper Photo Analysis) que aparenta misturar CAD (Computer Aided Design, usado para arquitetura) com Photoshop, empregado para manipular imagens e com funções 3D. A sequência em que Deckard descobre uma replicante numa banheira dando zoom em diferentes ângulos da imagem e se valendo do reflexo parcial de um espelho resume, mais de três décadas atrás, a ubiquidade do 3D hoje em dia. A possibilidade de explorar os recônditos de uma imagem também lembra as fotos panorâmicas que podemos tirar nos smartphones de hoje e os takes em 360 graus no Facebook.

Amor e sexo entre homem e máquina

No entanto, é o amor/erotismo que inspira alguns dos melhores momentos em ambos os filmes. No de 1982, está em Rachel, a replicante “state of the art” com quem Deckard se envolve e cuja autossuficiência é superada por algo que poderíamos identificar como sentimento, que aflora quando o detetive a subjuga e a obriga a repetir “me beija” e “eu quero você” (ao qual ela emenda “ponha as mãos em mim”). Em 2049 (SPOILER!), a personagem, apenas mostrada en passant, é a chave do limiar entre máquina e humano.

Por sua vez, a assistente virtual holográfica Joi (Ana de Armas) é, no filme atual, a personificação do sonho de muitos solitários que passam suas noites nas redes sociais.

Este tipo de assistente já foi mostrado (de forma mais tosca) no filme “O sexto dia”, com Arnold Schwarzenegger. E também no filme “Ela”, com Joaquin Phoenix e a voz de Scarlett Johansson como uma espécie de Siri por quem Phonenix se apaixona. Já no “Blade Runner” de 1982, a personagem de Daryl Hannah, a androide Pris, é apresentada como modelo programado para o prazer sexual. Para o mesmo fim são criadas as androides prostitutas do saloon da série “Westworld”, da HBO. Em “Be right back”, episódio de abertura da segunda temporada da série “Black Mirror”, da Netflix, o oposto é mostrado: um androide idêntico a um jovem marido falecido assume o posto na vida da viúva (que o encomendou, inconsolável), com implicações imprevisíveis.

(ALERTA DE SPOILER!) Mas, voltando a Joi, em 2049 ela é a companheira virtual do policial replicante K, ativada inicialmente por um console ao lado da porta do apartamento de K e depois por um dispositivo portátil. Joi está sempre com ele e deseja ter um corpo físico para se unir carnalmente ao parceiro. Para tal fim, ocupa o corpo de uma prostituta, e o resultado é uma bela ménage à trois high tech.

Para David Svaiter, arquiteto de software, especialista em criptografia e diretor da empresa de sistemas e consultoria Oasys, em aproximadamente cinco anos será possível ver a conjugação da inteligência artificial incorpórea com o potencial da tecnologia holográfica.

“O avanço a olhos vistos do machine learning, a capacidade de aprendizado das máquinas, já começa a permitir diálogos com um ser humano, que tendem a ser mais e mais inteligentes com o passar do tempo. Já há, por exemplo, bots de software em call centers capazes de permitir essa interação”, diz David. “O principal desafio para a popularização de eventuais hologramas portáteis é o tempo de vida das baterias dos gadgets da Internet das Coisas (IoT, na sigla em inglês). Hoje já há desenvolvimento de hologramas em 3D com cruzamento de lasers. Acredito ser plenamente possível a conjugação das duas tecnologias para criar uma futura experiência mais pessoal com os assistentes virtuais”.

Por outro lado, hoje o mais próximo que existe no sentido de uma relação sexual entre um ser humano e um dispositivo são as bonecas(os) eróticas(os) inteligentes, projetadas(os) por empresas como a Reall Doll. Ainda assim, apenas a cabeça das bonecas recebe os sistemas digitais para interagir, controlados por um aplicativo num tablet ou smartphone. O corpo permanece um objeto.

Também houve um caso na China este ano em que um engenheiro de inteligência artificial decidiu se casar com uma robô criada por ele mesmo.

Ambas as personagens (Rachel e Joi) da sequência de Blade Runner são metáforas da falta de empatia entre os próprios seres humanos naquele futuro ficcional. Se ainda não estamos tão avançados tecnologicamente para essa personificação do relacionamento entre ser humano e máquina, o sentido da solidão que hoje se queda por trás das veredas da internet é bem real. Deckard, já velho, lacra a questão em 2049 ao dizer a K que às vezes, para amar alguém, é preciso que ele seja desconhecido.

Engenharia de lembranças

Finalmente, uma das vertentes tech mais interessantes do “Blade Runner” atual (SPOILER!) é o trabalho da projetista de lembranças, a doutora Anna Stelline (Carla Juri), que vive sob uma redoma. O aparelho de que Anna se vale para criar cenários e memórias parece uma teleobjetiva, só que manuseada lateralmente, com seus anéis e lentes calibrados para moldar diferentes “realidades virtuais” a serem implantadas nos androides.

“O poder das lembranças foi uma das coisas que me chamaram a atenção na história”, disse Dennis Villeneuve, diretor do filme, em recente entrevista ao site Slashfilm. “Isso, e as dúvidas de alguém sobre sua identidade, seu próprio eu, e quanto ao seu passado, se ele é real ou um sonho”.

A tecnologia da doutora Stelling remete à realidade virtual, cada vez mais aplicada atualmente em games, aplicativos de realidade aumentada em celulares e, claro, em produções cinematográficas e televisivas. Aparelhos como o Oculus Rift, o PlayStation VR ou o Samsung Gear VR permitem vivenciar jogos em imersão, como “The Climb”, “Star Wars Battlefront: Rogue One X-Wing VR Mission” e “EVE: Valkyrie”.

Relacionadas

Jornalista há mais de três décadas, trabalhou em locais como a Rádio Fluminense FM, o Grupo Manchete e o jornal O Globo, onde cobriu tecnologia no caderno Informática Etc e na editoria Digital & Mídia. Publicou livros sobre o tema e também de ficção ("Daniela e outras histórias", contos, Multifoco, 2012).

Nota da Redação: André Machado morreu em 2021, vítima da covid-19.

Excelente resenha!

Agradeço o cuidado em abrir as frentes de análise, muito bom!

Claudia Lessa

Se O Caçador de Androides trabalhava a definição de humanidade e a busca por identidade, 2049 tenta expandir os devaneios filosóficos de seu antecessor e trata da humanidade relacionada às nossas percepções de realidade e memória. O filme Blade Runner 2049 me manteve tensa todo o momento, se ainda não a viram, eu acho que é o melhor filme de ficção cientifica que foram lançados.. No elenco vemos Ryan Gosling e Ana de Armas, dois dos atores mais reconhecidos de Hollywood que fazem uma grande atuação neste filme. Realmente a recomendo.